Asana vs. Trello: Welches Projektmanagement-Tool ist besser?

.svg)

Viele mittelständische Produktionsunternehmen stehen an fast derselben Stelle. Die Maschinen laufen noch, das ERP ist über Jahre gewachsen, Excel füllt die Lücken, und gleichzeitig steigen Druck auf Lieferfähigkeit, Transparenz und Kostenkontrolle. Das Problem ist selten fehlender Wille. Es ist die Frage, wie man sinnvoll anfängt, ohne eine funktionierende Fabrik in ein riskantes Grossprojekt zu verwandeln.

Genau dort werden industrie 4.0 lösungen interessant. Nicht als Schlagwort, sondern als Architekturentscheidung. Es geht darum, Maschinendaten nutzbar zu machen, Prozesse durchgängig zu verbinden und operative Entscheidungen schneller und fundierter zu treffen. Für CTOs und technische Leiter im deutschen Mittelstand ist das kein Zukunftsthema mehr, sondern ein Umsetzungsproblem mit sehr konkreten Randbedingungen: Legacy-Anlagen, heterogene Schnittstellen, begrenzte Teams und ein hoher Anspruch an Verfügbarkeit.

Wer Industrie 4.0 sauber einführt, braucht deshalb keine PowerPoint-Strategie, sondern ein belastbares Zielbild, eine vernünftige Integrationsarchitektur und eine Roadmap, die Brownfield-Realität ernst nimmt.

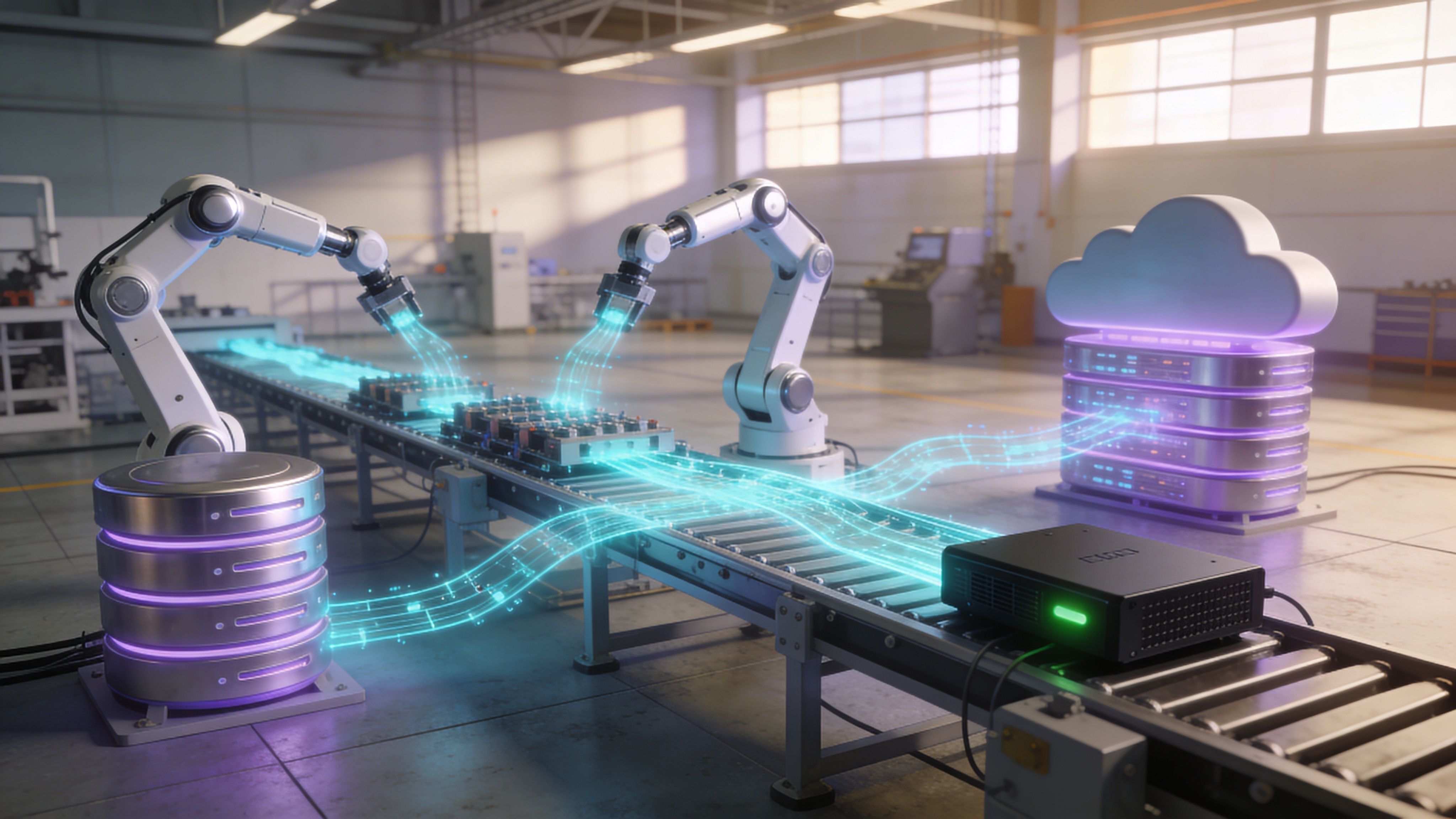

Industrie 4.0 klingt oft grösser und diffuser, als es im Alltag der Fertigung tatsächlich ist. In der Praxis geht es um etwas sehr Konkretes: Maschinen, Produktionssysteme und Geschäftssysteme so zu vernetzen, dass aus Daten operative Steuerung wird.

Das heisst nicht automatisch vollautonome Fabrik. Es heisst zuerst, Zustände sichtbar zu machen, Ursachen zu erkennen und Reaktionen zu standardisieren. Wenn eine Linie ungeplant stoppt, ein Werkzeug verschleisst oder Material falsch disponiert wird, sollten die beteiligten Systeme das nicht erst im Nachhinein feststellen.

Ein pragmatisches Verständnis hilft mehr als jede Theoriedebatte. Industrie 4.0 beginnt meist mit vier Fragen:

Wenn diese Fragen sauber beantwortet sind, wird aus dem Buzzword ein Architekturvorhaben.

"Industrie 4.0 ist dann nützlich, wenn ein Betrieb nicht einfach mehr Daten sammelt, sondern bessere Eingriffe in reale Abläufe ermöglicht."

Im Mittelstand scheitern Digitalisierungsprojekte selten an der Idee. Sie scheitern an unpassender Umsetzung. Ein Konzern kann komplette Plattformen einkaufen und über Jahre integrieren. Ein kleineres oder mittleres Unternehmen braucht einen anderen Ansatz.

Typische Rahmenbedingungen sind:

Deshalb funktionieren industrie 4.0 lösungen im Mittelstand am besten, wenn sie modular, schrittweise und messbar eingeführt werden. Nicht alles auf einmal. Nicht mit einem Big-Bang-Rollout. Sondern mit klar priorisierten Anwendungsfällen, die technisch sauber integriert werden und geschäftlich relevant sind.

Der Begriff Industrie 4.0 wurde 2011 in Deutschland eingeführt, um die Wettbewerbsfähigkeit der Industrie zu stärken. Die Initiative wurde von der Bundesregierung finanziert, erste Umsetzungsempfehlungen wurden 2013 auf der Hannover Messe vorgestellt, und laut Statista nutzen heute 71 % der deutschen Unternehmen Industrie-4.0-Technologien. Das unterstreicht, wie breit das Thema bereits in der Industrie verankert ist (DIN Whitepaper mit Verweis auf Statista).

Technisch besteht das Thema nicht aus einem Produkt. Es ist ein Zusammenspiel mehrerer Schichten. Wer diese Schichten nicht trennt, baut schnell eine Lösung, die im Pilot funktioniert, aber im Rollout bricht.

Das Industrial Internet of Things, kurz IIoT, verbindet Maschinen, Sensoren, Aktoren und Steuerungen mit Software-Systemen. Es erfasst Zustände, Ereignisse und Messwerte dort, wo sie entstehen.

Das ist die Basis jeder weiteren Logik. Ohne saubere Erfassung gibt es weder Monitoring noch Optimierung.

Praktisch heisst das:

IIoT ist nicht nur Connectivity. Es ist die Voraussetzung dafür, dass Daten verlässlich und reproduzierbar aus der Produktion herauskommen.

Nicht jede Entscheidung gehört in die Cloud. Manche Signale müssen lokal bewertet werden, weil Latenz, Ausfallsicherheit oder Bandbreite entscheidend sind.

Edge Computing verarbeitet Daten nahe an der Maschine. Das ist sinnvoll, wenn ein Modell eine Anomalie erkennt, eine Vorverarbeitung laufen soll oder ein lokales Dashboard für Schichtleiter benötigt wird.

Gute Edge-Architekturen übernehmen typischerweise:

Die Cloud ist nicht das Gehirn der Fabrik im romantischen Sinn. Sie ist in vielen Fällen die richtige Schicht für Historisierung, übergreifende Analytik, Modelltraining und Integration mit Business-Systemen.

Dort laufen typischerweise:

Wer Datenplattformen plant, sollte sich früh mit Datenmodell, Mandantenfähigkeit, Zugriffsrechten und Betriebsmodell beschäftigen. Sonst entsteht später ein teures Sammelbecken ohne klare Verantwortlichkeiten.

Für Teams, die tiefer in die Auswertung grosser Datenmengen einsteigen wollen, ist auch der Blick auf Big Data Analyse in der Praxis sinnvoll, vor allem wenn Produktionsdaten mit Qualitäts- oder Logistikdaten verknüpft werden sollen.

Viele Projekte scheitern nicht an Sensoren, sondern an der fehlenden Sprache zwischen Systemen. OPC UA ist hier zentral, weil es Maschinen und Anwendungen einen standardisierten Austausch ermöglicht.

Daneben spielen zwei operative Rückgrate eine grosse Rolle:

Zwischen beiden liegen oft Brüche. Industrie 4.0 schliesst diese Brüche nicht automatisch, macht sie aber sichtbar und adressierbar.

Der digitale Zwilling ist wiederum kein Selbstzweck. Er wird dann wertvoll, wenn Teams Abläufe simulieren, Änderungen testen oder Zustände virtuell nachvollziehen wollen, bevor sie in die reale Produktion eingreifen.

"Praktische Regel: Erst die Datenkette stabilisieren, dann Visualisierung und Modelle darauf aufbauen. Ein schöner Zwilling auf unsauberen Daten bleibt Dekoration."

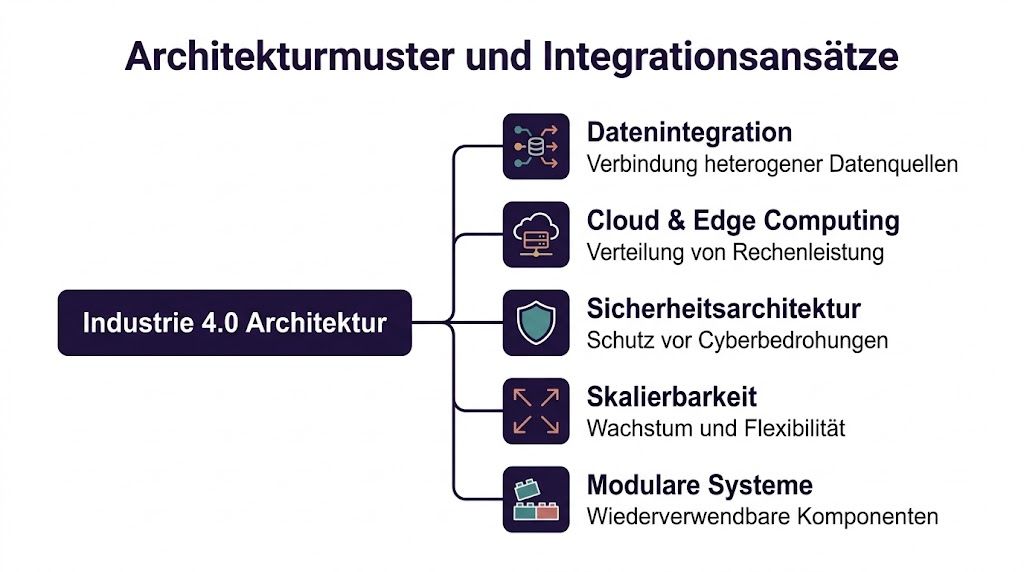

Die eigentliche Qualität von industrie 4.0 lösungen zeigt sich nicht bei der Auswahl einzelner Tools, sondern in der Art, wie Daten und Steuerungslogik zusammengeführt werden. Eine gute Architektur hält Heterogenität aus. Eine schlechte Architektur setzt stillschweigend voraus, dass alle Maschinen modern, alle Schnittstellen sauber und alle Daten vollständig sind.

In den meisten produktionsnahen Architekturen läuft der Datenfluss in fünf Schritten:

Dieses Muster wirkt banal, ist aber bewährt. Es trennt die Verantwortung sauber und verhindert, dass jede Maschine ihre eigene Mini-Plattform mitbringt.

In deutschen Werken ist Brownfield die Regel. Bestehende Maschinen bleiben lange in Betrieb, weil sie produktiv sind und oft mechanisch noch völlig ausreichend arbeiten. Der Fehler liegt dann in der Annahme, Digitalisierung sei nur über Ersatzinvestitionen möglich.

Genau hier ist Retrofitting oft der wirtschaftlichste Weg. Laut Fraunhofer IOSB-INA ermöglichen skalierbare Retrofit-Lösungen die kosteneffiziente Integration bestehender Maschinen. Durch das Nachrüsten von Sensoren und Edge-Modulen werden Maschinendaten zugänglich, ohne teure Neuinvestitionen. In deutschen KMU wurden dabei Ausfallreduktionen von bis zu 30 %, ein ROI innerhalb von 12 bis 18 Monaten sowie Nachrüstkosten von 20 bis 50 % unter Neuanlagen dokumentiert (Fraunhofer IOSB-INA zu Industrie 4.0 Retrofit).

Einige Entscheidungen sollte man nicht vertagen. Sie beeinflussen fast alles, was später kommt.

RAMI 4.0 ist in der Praxis weniger ein tägliches Arbeitswerkzeug als ein hilfreicher Strukturrahmen. Das Modell zwingt Teams dazu, Ebenen sauber zu unterscheiden. Asset, Kommunikation, Information, Funktion und Business gehören nicht in dieselbe Diskussion.

Das schützt vor typischen Missverständnissen. Ein OT-Team spricht sonst über Signale, während das ERP-Team über Auftragsstatus diskutiert und die Softwareentwicklung bereits APIs baut, ohne dass ein gemeinsames Zielbild steht.

"Wenn Pilotprojekte schwer wartbar werden, liegt das oft nicht am Piloten selbst, sondern daran, dass Integrationsmuster nie standardisiert wurden."

Ein Industrie-4.0-Projekt bekommt nur dann dauerhaft Budget, wenn es als Geschäftsinitiative verstanden wird. Reine Technologierhetorik reicht im Management nicht. Entscheidend ist, welche operative Kennzahl sich verbessert und wie belastbar dieser Zusammenhang ist.

In Deutschland setzen bereits 71 % der Unternehmen Industrie-4.0-Lösungen ein. Praxisbeispiele wie bei thyssenkrupp AG zeigen, dass Predictive Maintenance Maschinenausfälle minimieren und die Fertigung transparenter machen kann. Diese Methoden sind branchenweit skalierbar und tragen zur Stärkung der wirtschaftlichen Leistung bei, indem sie Effizienzgewinne und bessere Ressourcennutzung ermöglichen (Statista-Themenseite zu Industrie 4.0).

Die besten Business Cases beginnen nicht mit Plattformen, sondern mit Verlustquellen. Das können ungeplante Stillstände sein, Qualitätsabweichungen, hohe manuelle Eingriffe oder mangelnde Transparenz in Auftragsfortschritt und Materialfluss.

Drei Fragen reichen oft aus:

Wenn ein Team diese Fragen nicht beantworten kann, ist das Vorhaben meist noch zu technologiegetrieben.

Für die Bewertung eignen sich wenige, harte Kennzahlen besser als ein grosses Reporting-Set. Relevant sind typischerweise:

Weniger hilfreich sind Kennzahlen, die nur den Digitalisierungsgrad selbst beschreiben. Ein neues Dashboard bringt keinen Nutzen, wenn niemand damit schneller oder besser entscheidet.

Viele Business Cases rechnen Hardware, Lizenzen und vielleicht noch Integrationsaufwand. Sie unterschätzen aber die Kosten auf der organisatorischen Seite.

Dazu gehören:

Ein pragmatischer Case kalkuliert deshalb nicht nur das System, sondern auch die Verhaltensänderung im Betrieb. Sonst wirkt ein Projekt auf dem Papier profitabel und verliert später an Akzeptanz.

"Ein Pilot ist wirtschaftlich nur dann gut, wenn er als Vorlage für weitere Linien oder Werke taugt. Ein isolierter Erfolg ohne Wiederverwendbarkeit bleibt teuer."

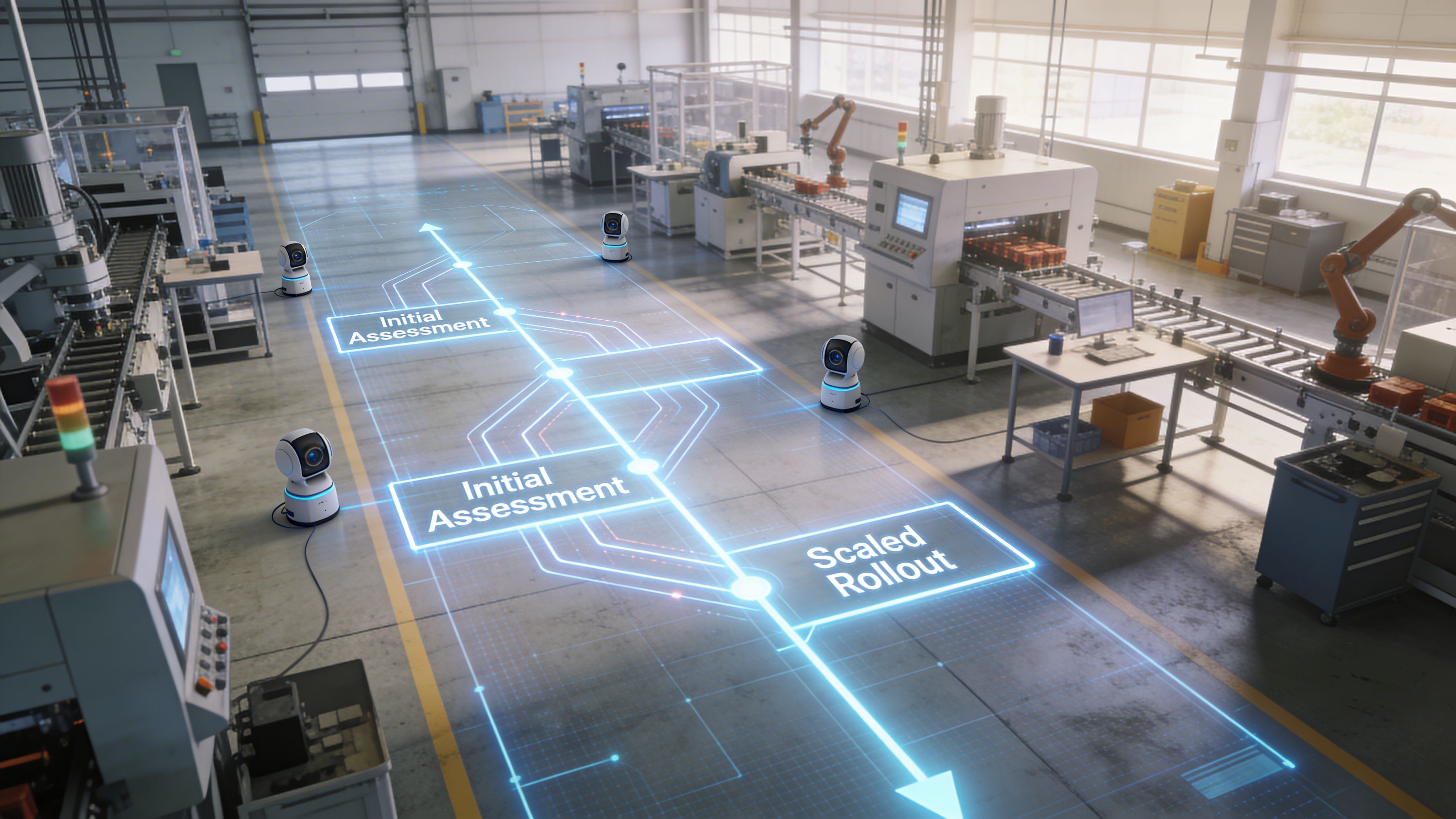

In vielen Werken scheitert die Einführung nicht an fehlenden Tools, sondern an falscher Reihenfolge. Teams kaufen zu früh Plattformen, definieren zu spät Datenverantwortung und wählen Piloten, die politisch attraktiv, aber technisch unrepräsentativ sind.

Für den deutschen Mittelstand sind Legacy-IT, Interoperabilität und Kosten die grössten Hürden bei der Einführung. Eine Studie zeigt, dass 73 % der Unternehmen noch bei manueller Automatisierung feststecken. Praxisnahe Strategien wie hybride Cloud-Modelle und die Einbindung externer Spezialisten gelten deshalb als entscheidend, um teure On-Premise-Ansätze zu vermeiden (Oracle zu Herausforderungen von Industry 4.0).

Der erste Schritt ist kein Einkauf, sondern ein belastbares Lagebild. Dazu gehört eine Bestandsaufnahme von Maschinen, Schnittstellen, Datenquellen, Netzwerken, Applikationen und betroffenen Teams.

Wichtig ist dabei nicht nur, was technisch möglich wäre, sondern was betrieblich sinnvoll ist.

Eine brauchbare Erstaufnahme beantwortet mindestens diese Punkte:

Der beste Pilot ist selten die modernste Linie. Er ist auch nicht die problematischste Anlage im Werk. Ein guter Pilot liegt dazwischen. Genug Relevanz für einen echten Nutzen, aber genug Beherrschbarkeit für ein überschaubares Risiko.

Geeignete Pilotfelder sind oft:

Weniger sinnvoll sind Piloten, die nur deshalb gewählt werden, weil ein Anbieter dafür eine schöne Demo hat.

"Wichtiger Prüfpunkt: Ein Pilot muss auf andere Linien übertragbar sein. Wenn jede Annahme nur für eine Sondermaschine gilt, fehlt die Skalierungsbasis."

Nach dem ersten produktiven Betrieb beginnt die eigentliche Arbeit. Jetzt zeigt sich, ob Sensorik verlässlich ist, ob Zustände korrekt modelliert wurden und ob Nutzer die Informationen in ihren Ablauf integrieren.

Typische Fragen in dieser Phase:

Spätestens jetzt sollten Teams Architekturkomponenten standardisieren. Dazu zählen Datenformate, Namenskonventionen, Rollenmodelle, Deployment-Muster und Betriebsprozesse.

Ein praktischer Eindruck dazu hilft oft mehr als Folien. Dieses Video zeigt einen greifbaren Einstieg in das Thema Industrie 4.0 und kann intern nützlich sein, um Fachbereiche und Technik auf ein gemeinsames Bild zu bringen.

Viele Unternehmen behandeln den Rollout wie eine Wiederholung des Piloten. Das ist ein Fehler. Ab dem zweiten oder dritten Standort braucht die Lösung Produktcharakter.

Das heisst konkret:

Der Rollout wird planbar, wenn ein Team nicht mehr jedes Werk neu erfindet. Dann entsteht aus dem ersten Use Case eine belastbare industrielle Softwarelandschaft.

Einige Muster tauchen in Projekten immer wieder auf und kosten unnötig Zeit:

Sobald Produktionsanlagen stärker mit IT-Systemen verbunden werden, ändern sich die Risiken. Ein isoliertes OT-Netz mit wenigen Übergängen verhält sich anders als eine vernetzte Umgebung mit Gateways, APIs, Cloud-Komponenten und Benutzerzugängen aus mehreren Rollen.

Gleichzeitig steigt mit jedem erfolgreichen Pilot der Druck zur Ausweitung. Dann zeigt sich schnell, ob eine Lösung wirklich skalierbar ist oder nur unter Laborbedingungen sauber lief.

Security by Design ist im industriellen Umfeld keine Stilfrage. Es ist Betriebsdisziplin. Wer Konnektivität nachträglich absichert, muss meist Kompromisse eingehen, die Verfügbarkeit, Wartbarkeit oder Transparenz verschlechtern.

Praktische Grundsätze sind:

Gerade bei Predictive-Maintenance-Szenarien gilt: Die Daten sind wertvoll, aber die Wege dorthin dürfen nicht beliebig offen sein.

Eine Lösung, die an einer Linie funktioniert, skaliert nicht automatisch auf zehn Linien oder mehrere Werke. Häufig wurden im Pilot Dinge stillschweigend manuell erledigt. Jemand benennt Daten um, korrigiert Ausreisser oder startet einen Dienst neu.

Im Rollout wird aus diesem stillen Wissen ein Problem.

Darauf sollte man früh achten:

Für Software-Teams, die tiefer in dieses Thema einsteigen wollen, ist auch der Blick auf Skalierbarkeit von Software und wie man sie plant hilfreich, besonders wenn aus einem Pilot eine unternehmensweite Plattform werden soll.

Predictive Maintenance ist eine Kernanwendung von Industrie 4.0. Durch die Analyse von Sensordaten mit KI können Maschinenausfälle mit einer Genauigkeit von über 95 % vorhergesagt werden. In deutschen Benchmarks sinken dadurch Ausfallzeiten um 25 bis 40 % und Wartungskosten um 10 bis 20 %. OPC UA ermöglicht dabei die schnelle Integration heterogener Systeme und ist für skalierbare sowie sichere Lösungen zentral (PTC zu Industry 4.0 und Predictive Maintenance).

Die eigentliche Lehre daraus ist nicht nur die Prognosequalität. Es ist die Bedeutung konsistenter Datenpipelines. Ein Modell wird nicht deshalb gut, weil es modern ist. Es wird gut, wenn Datenerfassung, Semantik, Zeitbezug und Rückmeldung in den Prozess stimmen.

"Wer zuerst Modellgenauigkeit diskutiert und erst später Datenqualität, baut auf Sand."

Ein wiederkehrendes Problem in Industrie-4.0-Projekten ist nicht die Strategie, sondern die Ausführungskapazität. Unternehmen wissen oft, welche Use Cases relevant wären. Es fehlt aber an Leuten, die OT-nahe Integration, Cloud-Architektur, Datenpipelines und produktionsfeste Software gleichzeitig beherrschen.

Dazu kommt eine zweite Schwierigkeit. Diese Fähigkeiten werden nicht dauerhaft in voller Auslastung gebraucht. Für den Aufbau eines Piloten, die Integration eines MES oder die Entwicklung eines Edge-Service braucht man sehr erfahrene Leute. Aber nicht jede Rolle muss danach langfristig intern besetzt sein.

Externe Senior-Entwickler sind besonders dann sinnvoll, wenn ein Projekt an einer Engstelle hängt, die intern nicht schnell genug geschlossen werden kann.

Typische Beispiele sind:

Der Vorteil liegt nicht nur in zusätzlicher Kapazität. Gute Senior-Profile bringen Vergleichswerte aus anderen Integrationsprojekten mit. Sie erkennen früh, welche Architektur tragfähig ist und welche nur kurzfristig funktioniert.

Eine Studie zeigt, dass nur 2 % der produzierenden Unternehmen in Deutschland personenbezogene Aspekte priorisieren. Gleichzeitig gibt es über 700.000 offene Stellen in IT und Fertigung. Genau deshalb können externe Senior-Developer-Netzwerke diese Lücke schliessen, indem sie Know-how für die Skalierung von Custom-Software bereitstellen, ohne interne Teams zusätzlich zu belasten (Dashöfer zur unvollständigen Industrie-4.0-Implementierung).

Für CTOs ist das vor allem eine Steuerungsfrage. Statt monatelang nach seltenen Profilen zu suchen, lässt sich gezielt dort verstärken, wo Umsetzung stockt.

Das funktioniert gut, wenn drei Bedingungen erfüllt sind:

Wer dafür flexibel Seniorität ergänzen will, findet etwa über Full-Stack-Entwickler buchen ein Modell, das sich eher an realen Projektphasen orientiert als an starren Personalplänen.

"Externe Hilfe ist dann am wertvollsten, wenn sie nicht nur entwickelt, sondern interne Teams schneller entscheidungsfähig macht."

Industrie 4.0 wird im Mittelstand nicht durch grosse Ankündigungen gewonnen. Sie wird durch saubere Integrationsarbeit gewonnen. Die wichtigsten Hebel sind klar: ein belastbarer Business Case, ein sinnvoll gewählter Pilot, eine Architektur, die Brownfield-Realität aushält, und Sicherheits- sowie Skalierungsentscheidungen von Anfang an.

Wer heute startet, sollte klein anfangen, aber nicht klein denken. Ein erster Use Case darf begrenzt sein. Die Architektur dahinter sollte es nicht sein.

Eine sinnvolle Reihenfolge sieht so aus:

Am Ende sind gute industrie 4.0 lösungen weder rein OT noch rein IT. Sie verbinden beides in einer Form, die im Werk funktioniert, im ERP ankommt und im Management messbar wird. Genau dort entsteht Wettbewerbsfähigkeit.

Wenn Sie für Industrie-4.0-Initiativen erfahrene Entwickler brauchen, die sich in bestehende Teams einfügen und komplexe Integrationsaufgaben pragmatisch umsetzen, unterstützt PandaNerds mit sorgfältig geprüften Senior-Entwicklern für flexible, kosteneffiziente Zusammenarbeit.