Asana vs. Trello: Welches Projektmanagement-Tool ist besser?

.svg)

Ein Release geht live. Das Team hat die Storys abgeschlossen, die Demo im Sprint Review sah gut aus, und aus Entwicklersicht funktioniert der wichtigste Flow. Zwei Tage später kommen die ersten Support-Tickets. Ein Formular speichert Eingaben nicht zuverlässig. Der Checkout bricht auf bestimmten Mobilgeräten ab. Eine Änderung im Frontend hat einen alten Admin-Prozess beschädigt. Die Features sind da, aber die Nutzbarkeit ist es nicht.

Genau an diesem Punkt kippt die Wahrnehmung eines Produkts. Nutzer unterscheiden selten zwischen „gute Idee, schlecht umgesetzt“ und „schlechtes Produkt“. Für sie zählt nur, ob die Webanwendung stabil, verständlich und schnell genug ist, um ihre Aufgabe zu erledigen.

Ein web app tester wird oft zu spät eingeplant. Viele Teams holen Testing erst dann sichtbar ins Boot, wenn Fehler bereits in Produktion angekommen sind. Das ist teuer. Nicht nur technisch, sondern auch geschäftlich. Ein schwacher erster Eindruck schadet Vertrauen, Support-Aufwand steigt, und das Entwicklungsteam arbeitet plötzlich nicht mehr am Produktfortschritt, sondern an Schadensbegrenzung.

Gerade bei digitalen Produkten mit mehreren Integrationen, Rollenmodellen und schnellen Releases reicht es nicht, wenn Entwickler ihre eigenen Features kurz prüfen. Gute Qualitätssicherung ist ein eigenes Handwerk. Wer bereits in angrenzenden Bereichen mit komplexen Produktanforderungen arbeitet, findet bei ARIT Services einen guten Praxisbezug zu marktreife IoT-Produkte durch umfassende Qualitätssicherung. Das Grundprinzip ist identisch. Qualität muss geplant, getestet und abgesichert werden, statt auf Glück zu vertrauen.

Wer intern noch diskutiert, wo ein Browserprodukt eigentlich zwischen Website und Anwendung einzuordnen ist, sollte zuerst den Unterschied sauber verstehen. Eine kompakte Einordnung liefert diese Erklärung, was eine Web-App ist.

Gute QS schützt nicht nur vor Bugs. Sie schützt Release-Geschwindigkeit, Reputation und die Fähigkeit, überhaupt verlässlich zu skalieren.

Ein professioneller Tester sucht deshalb nicht nur Fehler. Er bewertet Risiko. Er erkennt Muster in instabilen Bereichen. Er stellt Fragen, die im Refinement oft niemand stellt. Und er bringt Struktur in die unangenehme, aber entscheidende Frage: Können wir dieses Feature verantwortbar ausrollen oder nicht?

Die verkürzte Vorstellung lautet oft: Der Tester klickt Dinge durch und meldet Bugs. In der Praxis ist die Rolle deutlich strategischer. Ein guter web app tester arbeitet an der Schnittstelle von Produkt, Entwicklung und Nutzerverhalten. Er prüft nicht nur, ob etwas technisch funktioniert, sondern ob ein reales Nutzungsszenario zuverlässig und nachvollziehbar abgebildet ist.

In Deutschland ist diese Disziplin kein Nischenthema. Die Dichte an Software-Testern liegt bei 37,1 pro 100.000 Einwohner. Damit steht Deutschland global auf Platz 2, was die Bedeutung professioneller Qualitätssicherung im Tech-Sektor klar unterstreicht, wie die Übersicht von Global App Testing zu Software-Testing-Statistiken zeigt.

Entwickler denken in Komponenten, Services, Zuständen und Abhängigkeiten. Nutzer denken in Aufgaben. „Ich will mich anmelden.“ „Ich will eine Rechnung herunterladen.“ „Ich will den Vorgang später fortsetzen.“ Ein Tester übersetzt zwischen diesen Ebenen.

Er prüft deshalb Fragen wie:

Nicht jeder Fehler ist gleich kritisch. Ein erfahrener Tester priorisiert nicht nach Lautstärke, sondern nach Geschäftsrisiko. Ein Darstellungsfehler in einer selten genutzten Backoffice-Seite ist etwas anderes als ein stiller Datenverlust in einem Kernworkflow.

Ein guter Tester liefert deshalb keine Liste isolierter Defekte, sondern Kontext:

Teams verwechseln oft Aktivität mit Testqualität. Viele Tickets im Bugtracker bedeuten nicht automatisch gute QS. Entscheidend ist, ob der Tester die relevanten Risiken früh sichtbar macht und dem Team hilft, sauber zu entscheiden.

Praxisregel: Der beste Tester meldet nicht die meisten Bugs. Er verhindert, dass die teuersten Bugs live gehen.

Dazu gehört auch Zusammenarbeit. Ein starker Tester schreibt reproduzierbare Tickets, benennt Vorbedingungen klar, dokumentiert Screenshots oder Videos sinnvoll und diskutiert Grenzfälle mit Entwicklern, bevor daraus Release-Blocker werden.

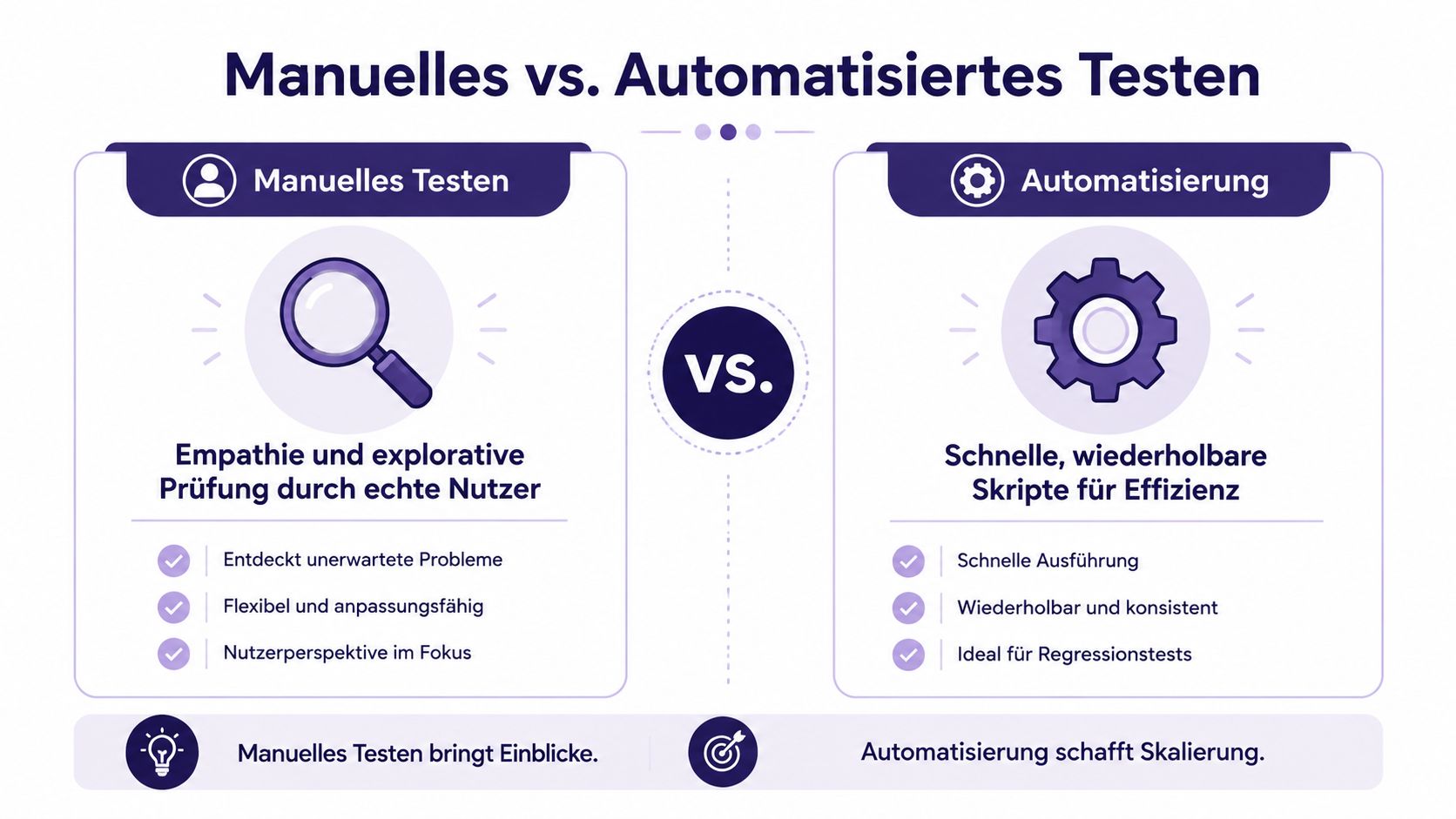

Manuelle und automatisierte Tests werden oft gegeneinander ausgespielt. Das ist ein Fehler. Reife Teams nutzen beides gezielt, weil beide Ansätze unterschiedliche Probleme lösen.

Manuelles Testen ist wie das Abschmecken eines Gerichts. Es prüft nicht nur, ob alle Zutaten vorhanden sind, sondern ob das Ergebnis stimmig ist. Automatisierung ist näher an einer standardisierten Qualitätskontrolle. Sie prüft zuverlässig, ob definierte Regeln bei jeder Wiederholung eingehalten werden.

Manuelles Testen ist stark, wenn Verhalten schwer vorherzusagen ist oder wenn Nutzererlebnis zählt.

Typische Fälle:

Automatisierte Tests lohnen sich bei wiederholbaren, klar definierten Abläufen. Sie sind vor allem dann wertvoll, wenn Releases häufiger werden und Regressionen teurer werden als der Aufbau des Testsets.

Sinnvolle Kandidaten sind:

Wer solche Abläufe in den Entwicklungsprozess einbettet, sollte Testing nicht als Extra behandeln, sondern als Teil der Lieferkette. Das passt direkt zu Continuous Integration in der Praxis, weil automatisierte Prüfungen nur dann wirken, wenn sie regelmäßig und verbindlich ausgeführt werden.

KI kann heute Testfälle generieren und beim Aufsetzen von Testabdeckung helfen. Das löst aber nicht das eigentliche Engpassproblem. 70 % der Cybersicherheitsexperten sagen, dass die schiere Anzahl der Anwendungen ein angemessenes Testen durch Menschen unmöglich macht, wie Userback zur Zukunft des Web-Application-Testings zusammenfasst.

Das heißt in der Praxis: KI erweitert Kapazität, aber sie ersetzt weder Urteilsvermögen noch Priorisierung. Jemand muss entscheiden, welche generierten Tests relevant sind, welche redundant sind und welche Risiken gar nicht in Standardmustern auftauchen.

Automatisierung skaliert Wiederholung. Menschen bewerten Bedeutung.

Teams scheitern oft an zwei Extremen. Entweder sie automatisieren zu früh und bauen fragile Tests für unausgereifte Oberflächen. Oder sie testen zu lange nur manuell und verlieren bei jedem Release Zeit und Verlässlichkeit. Die bessere Entscheidung ist fast immer eine Staffelung: Kernrisiken zuerst automatisieren, neue Bereiche manuell erkunden und das Testset erst dann verbreitern, wenn die Funktion fachlich stabil ist.

Ein web app tester verbringt seinen Tag nicht nur mit dem Ausführen von Testfällen. Er analysiert Anforderungen, bewertet Risiken, baut Testdaten, prüft Logs und API-Antworten, dokumentiert Defekte, validiert Fixes und beobachtet, welche Bereiche nach Releases immer wieder auffällig werden.

Der Kern liegt in einigen Testarten, die fast jedes Produkt braucht. Nicht jede davon muss von Tag eins an voll ausgebaut sein. Aber jede davon adressiert ein anderes Geschäftsrisiko.

Das hängt vom Produktstadium ab. Für ein MVP ist die Frage oft: Funktionieren die Kernabläufe für frühe Nutzer stabil genug? Bei einem wachsenden SaaS-Produkt verschiebt sich der Fokus eher auf Regression, Performance und Rechtekonzepte.

Hilfreich ist eine einfache Priorisierungstabelle:

In kleinen Teams ist Spezialisierung begrenzt. Dann übernimmt ein erfahrener Tester oft mehrere Disziplinen. In reiferen Strukturen lohnt die Trennung zwischen funktionalem QA, Testautomatisierung und Security-Prüfung. Wichtig ist nicht die perfekte Organigramm-Lösung, sondern ein klares Qualitätsziel pro Release.

Viele Unternehmen stellen einen Tester zu spät ein. Der typische Auslöser sind steigende Support-Anfragen, hektische Hotfixes oder ein Release, dem das Team intern schon nicht mehr vertraut. Besser ist eine frühere Entscheidung, sobald das Produkt nicht mehr nur vom Gründer oder einem kleinen Entwicklerkreis verstanden wird.

Der Markt macht diese Entscheidung nicht leichter. Für Deutschland wird eine Lücke von 15.000 offenen Stellen für Tester bis 2026 prognostiziert, bei einem Durchschnittsgehalt von 85.000 €. Gleichzeitig nennen 62 % der Scale-ups unzureichende Testabdeckung als Engpass. Deshalb werden alternative Modelle wie Nearshoring praktisch relevant.

Ein Tester ist meist fällig, wenn mindestens zwei der folgenden Punkte auftreten:

Gerade für KMU und Scale-ups ist das externe Modell oft realistischer, weil es schneller Kapazität schafft und sich besser an Release-Zyklen anpasst. Entscheidend ist nicht die geografische Nähe allein, sondern die operative Einbindung. Ein Tester wirkt nur dann, wenn er Zugang zu Anforderungen, Tickets, Staging, Logs und den relevanten Entscheidern hat.

Nicht jeder Hiring Manager kann Testkompetenz aus dem CV lesen. Deshalb sollte das Interview auf Verhalten und Arbeitsweise zielen.

Sinnvolle Fragen sind zum Beispiel:

Wer den Zusammenhang von Testing, Planung und Releases besser im Ganzen betrachten will, sollte auch den Lebenszyklus einer Software im Blick haben. Die Qualität eines Produkts entsteht nicht erst beim Testen am Ende, sondern in jeder Phase davor.

Ein überzeugendes Profil ist noch kein Beleg für wirksame QA-Arbeit. Gute Kandidaten erkennt man daran, wie sie denken, wie sie Risiken zerlegen und wie sie mit Entwicklern zusammenarbeiten, wenn es unangenehm wird.

Lebensläufe sind im Testing oft schwerer zu lesen als bei Entwicklern. Ein langer Tool-Stack sagt wenig aus, wenn kein erkennbarer Qualitätsbeitrag dahintersteht.

Achten Sie eher auf diese Signale:

Statt Wissensquiz funktionieren Szenariofragen deutlich besser.

Ein starker Tester beschreibt nicht nur, was kaputt ist. Er beschreibt, wie das Team den Schaden eingrenzt und eine sichere Entscheidung trifft.

Ein besonders hilfreicher Punkt betrifft Security und Fix-Validierung. Über die Hälfte der Cybersicherheitsexperten gibt an, Schwierigkeiten bei der Behebung gefundener Lücken zu haben. Genau deshalb ist eine gute Interviewfrage, wie ein Tester Entwickler bei Lösungsfindung und Validierung unterstützt, um sogenanntes Remediation-Burnout zu vermeiden, wie Cycognito zu den Schwierigkeiten im Web-Application-Security-Testing beschreibt.

Diese Frage ist wertvoll, weil sie den Unterschied zwischen einem reinen Defect-Melder und einem produktiven Teammitglied offenlegt.

Der beste Tester bringt wenig, wenn er außerhalb des Entwicklungsprozesses sitzt. Qualität entsteht nicht durch eine späte Kontrollinstanz, sondern durch frühe Beteiligung und klare Verantwortlichkeiten.

Ein Tester sollte in Refinements dabei sein, kritische Akzeptanzkriterien hinterfragen und vor der Umsetzung auf Risiken hinweisen. Im Sprint prüft er nicht nur fertige Tickets, sondern beobachtet Muster: unstabile Komponenten, unklare Anforderungen, fehlende Testdaten oder wiederkehrende Missverständnisse zwischen Product und Entwicklung.

In Remote- und Nearshore-Setups braucht das Team dafür saubere Rituale:

Qualität sinkt selten an fehlender Motivation. Sie sinkt an unklaren Zuständigkeiten, schwachen Übergaben und zu spätem Feedback.

Viele Teams messen nur die Zahl gefundener Bugs. Das führt in die falsche Richtung. Gute QS soll Produktion stabilisieren, nicht Ticketmengen maximieren.

Besser sind Kennzahlen wie:

Nicht an der Menge der Artefakte. Sondern daran, dass Releases berechenbarer werden. Das Team diskutiert weniger über Bauchgefühl. Product, Engineering und QA sprechen dieselbe Sprache, wenn es um Risiko geht. Support bekommt seltener Überraschungen aus der Produktion. Und Entwickler verbringen weniger Zeit damit, alte Fehler unter Zeitdruck erneut einzufangen.

Qualitätssicherung ist deshalb keine Kostenstelle, die man nur aus Compliance-Gründen mitführt. Sie ist ein direkter Hebel für Nutzerbindung, belastbare Releases und ein Produkt, das auch unter Wachstum nicht auseinanderfällt.

Wenn Sie Ihr Team mit erfahrenen Remote-Entwicklern oder testnahen Senior-Profilen erweitern wollen, unterstützt PandaNerds beim Aufbau eingespielter, pragmatischer Software-Teams. Besonders für KMU, Scale-ups und frühe Produktphasen ist ein Modell hilfreich, das schnelle Integration, klare Kommunikation und flexible Auslastung verbindet.